§ Информация и информационные процессы

1. Понятие информации. Информация и информационные процессы.

2. Свойства информации.

3. Методы обработки данных .

4. Структуры данных.

5. Информационные основы процессов управления.

6. Информационная деятельность человека.

1.1.Понятие информации. Информация и информационные процессы.

Понятие информация достаточно широко используется в обычной жизни современного человека, поэтому каждый имеет интуитивное представление, что это такое. Слово информация происходит от латинского informatio — разъяснение, изложение. Но когда наука начинает применять общеизвестные понятия, она уточняет их, приспосабливая к своим целям, ограничивает использование термина строгими рамками его применения в конкретной научной области.

Сложность явления информации, его многоплановость, широта сферы применения и быстрое развитие отражается в постоянном появлении новых толкований понятий информатики и информации. Поэтому имеется много определений понятия информации, от наиболее общего философского — “Информация есть отражение реального мира»[1] ) до узкого, практического — “Информация есть все сведения, являющееся объектом хранения, передачи и преобразования” [2] ).

Приведем для сопоставления также некоторые другие определения и характеристики:

1. «Информация — это содержание сообщения или сигнала, т.е. сведения, рассматриваемые в процессе их передачи или восприятия, позволяющие расширить знания об интересующем объекте» [3] ).

2. «Информация — это сведения, передаваемые одними людьми другим людям устным, письменным или каким-нибудь другим способом» (БСЭ).

3. «Информация — это отраженное разнообразие, то есть нарушение однообразия»1).

4. «Информация является одним из основных универсальных свойств материи»1).

Под информацией необходимо понимать не сами предметы и процессы, а их отражение или отображение в виде чисел, формул, описаний, чертежей, символов, образов. Сама по себе информация может быть отнесена к области абстрактных категорий, подобных, например, математическим формулам, однако работа с ней всегда связана с использованием каких-нибудь материалов и затратами энергии. Информация хранится в наскальных рисунках древних людей в камне, в текстах книг на бумаге, в картинах на холсте, в музыкальных магнитофонных записях на магнитной ленте, в данных оперативной памяти компьютера, в наследственном коде ДНК в каждой живой клетке, в памяти человека в его мозгу и т.д. Для ее записи, хранения, обработки, распространения нужны материалы (камень, бумага, холст, магнитная лента, электронные носители данных и пр.), а также энергия, например, чтобы приводить в действие печатающие машины, создавать искусственный климат для хранения шедевров изобразительного искусства, питать электричеством электронные схемы калькулятора, поддерживать работу передатчиков на радио и телевизионных станциях. Успехи в современном развити информационных технологий в первую очередь связаны с созданием новых материалов, лежащих в основе электронных компонентов вычислительных машин и линий связи.

Таким образом, с информацией мы постоянно сталкиваемся в реальной жизни, она наряду с такими понятиями, как вещество и энергия, является одним из основных понятий науки.

Все, что нас окружает, относится либо к физическим телам, либо к физическим полям. Физические тела находятся в непрерывном движении, а физические поля непрерывно изменяются. Все это сопровождается появлением сигналов, имеющих энергетическую природу, и их можно регистрировать. В момент регистрации сигналов образуются данные.

Примечание .

Если эти данные, полученные каким-либо способом, востребованы, они становятся информацией иными словами информация — это продукт взаимодействия данных и адекватных им методов обработки [4] ) .

Пример: Учитель объясняет материал урока. Звуковые сигналы, в виде звуковых волн, достигая ваших ушей, регистрируются вашим мозгом и становятся данными. Если учитель говорит на знакомом вам языке, то данные могут быть вами усвоены и они станут для вас информацией. Если учитель говорит на незнакомом вам языке, то информацией по данному предмету эти данные не станут, а останутся просто набором данных.

Вывод : не все данные становятся информацией .

Отсюда следует, что

Определение. Информация – это совокупность знаний о фактических данных и зависимостях между ними.

Информацию можно сгруппировать по различным признакам, в частности, следующим:

1. По области возникновения. Информация, отражающая процессы, явления неодушевленной природы называется элементарной или механической, процессы животного и растительного мира — биологической, человеческого общества — социальной.

2. По способу передачи и восприятию. Информацию, передаваемую видимыми образами и символами называют визуальной, ощущениями – тактильной и т.д.

3. По общественному назначению. Информация может быть личной, массовой, социальной.

1.2.Свойства информации.

К информации предъявляется ряд требований, т.е. любая информация должна обладать определенными свойствами:

§ Полнота или качество информации, определяющее достаточность данных для принятия решения либо для создания новых данных на основе уже имеющихся.

§ т очность информации — это степень детализации описания свойств изучаемого объекта (системы, процесса, явления).

§ Достоверность информации — это показатель истинности, то есть степени близости полученных данных реальным исходным. При передаче любой информации наряду с необходимыми данными часто присутствуют и посторонние данные, которые частично искажают исходную информацию. Например, если в телефонной линии сильные помехи, то некоторые слова собеседника вы можете или не расслышать, или воспринять совершенно по иному.

§ Адекватность информации — это степень соответствия исходной информации реальному состоянию объекта. Неадекватная информация может возникать на основе неполных или недостоверных данных, или если к информации применяются неадекватные методы.

§ Доступность информации — это мера возможности получить ту или иную информацию. Например, если вы знаете, что где-то есть ответы на все вопросы экзаменационных билетов, но добыть их не можете.

§ Актуальность или востребованность информации, которая определяет степень ценности информации к моменту ее использования.

§ Оперативность или своевременность информации тесно связана с предыдущим свойством. Любая информация имеет определенную ценность, лишь когда она поступает вовремя.

§ Объективность и субъективность информации — мера влияния методов обработки на искажение самой информации или ее полноты. Это понятие является относительным, так как критерии оценки могут быть разными. Более объективной принято считать ту информацию, в которую методы вносят меньший субъективный элемент. Так, например, фотография объекта содержит более объективную информацию, чем рисунок этого объекта.

Все свойства информации определенным образом взаимосвязаны между собой и в целом определяют так называемое качество информации.

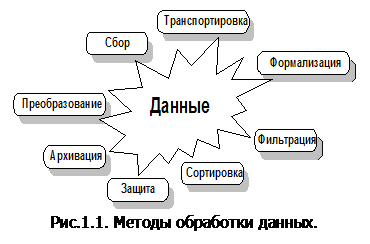

1.3.Методы обработки данных.

Для того, чтобы на основе полученных данных, то есть зарегистрированной информации, принять какое-нибудь решение, необходимо произвести с данными определенные действия, или операции, то есть применить методы обработки анных.

Для того, чтобы на основе полученных данных, то есть зарегистрированной информации, принять какое-нибудь решение, необходимо произвести с данными определенные действия, или операции, то есть применить методы обработки анных.

Можно выделить следующие методы обра-ботки данных (рис.1.1):

§ Сбор данных — это накопление информации с целью обеспечения ее достаточной полноты для принятия решений.

§ Транспортировка данных — это передача их между источником и приемником информации.

§ Формализация данных — это приведение их к одинаковой форме для возможности сопоставления, т.к. информация из разных источников часто представляется по разным правилам и в разных форматах.

§ Фильтрация данных — это отсеивание лишней информации, которая не требуется для принятия решения. При этом повышается коэффициент информативности сообщений.

§ Сортировка данных — это процедура их упорядочивания по какому-либо признаку для удобства их использования.

§ Защита данных — это реализация мер, направленных на предотвращение угроз утраты, искажения и перехвата информации, предназначенной получателю.

§ Архивация данных — это организация их хранения в удобной и легкодоступной форме.

§ Преобразование данных — это перевод их из одной формы представления в другую. Это обычно связано с изменением типа носителя.

Пример: Можно выдать задание устно, а можно зафиксировать на бумаге или записать на магнитную ленту и т.п. Необходимость преобразования возникает при передаче данных. В частности, звуковые сигналы при передаче их по телефонной линии приходится преобразовывать в электрические, а потом, на приемной стороне, производить обратное преобразование.

1.4.Структуры данных.

Работа с большими наборами данных автоматизируется проще, когда данные упорядочены, то есть образуют заданную структуру. Различают три основных вида структур: линейную, табличную и иерархическую.

§ Линейная структура или список отличается тем, что ее каждый элемент данных однозначно определяется своим номером в массиве.

Пример: Простейшая подобная структура — это обычный список группы. Каждая фамилия в списке зарегистрирована под уникальным номером. Номер обычно называется адресом.

В линейной структуре все элементы списка должны быть зарегистрированы под своим адресом, то есть не должно быть двух элементов с одним и тем же адресом, (это будет восприниматься как один элемент) и не может быть элементов списка не имеющих адресов.

§ В табличной структуре данных все элементы, входящие в таблицу имеют два параметра — номер строки и номер столбца, на пересечении которых эти элементы находятся. Существуют и многомерные таблицы, в которых для однозначного поиска элемента требуется задавать три и более параметров (координат).

Примечание.

Списки и таблицы хороши, когда мы имеем дело с регулярными данными. Но существуют информационные массивы, этим свойством не обладающие. Такова система почтовых адресов. Здесь элементом массива данных является адресат с указанием города, улицы, номера дома и квартиры. Условно такую структуру можно представить в виде дерева, вершиной которого является название города, ветвями – улицы, а более мелкими ветвями номера домов. Т.е. здесь есть как бы главенствующие элементы адреса и подчиненные.

§ Такая структура данных и называется иерархической. Адрес каждого элемента тут задается в виде пути доступа к нему, ведущем от вершины структуры по соответствующим ветвям.

При организации хранения данных требуется решить две основные проблемы: сохранить их в наиболее компактном виде и обеспечить к ним удобный и быстрый доступ.

1.5.Информационные процессы.

Определение. Информационный процесс – это процесс восприятия, накопления, хранения, обработки и передачи информации.

§ Процессы восприятия, хранения и накопления информации человеком заключаются в том, что информация воспринимается, запоминается и накапливается в памяти человека. Для удобства и с целью предотвращения потери информации человек заносит информацию на внешние носители информации (бумагу, магнитофонную ленту, в память компьютера) и там ее хранит и накапливает.

§ Процесс передачи информации от человека к человеку двусторонний: есть источник и приемник информации. Информация может передаваться и с помощью технических средств связи: телефон, радио, телевидение, Интернет, по каналам передачи информации. Количество информации, передаваемой за единицу времени по информационному каналу называется скоростью передачи информации или скоростью информационного потока.

§ Процессом обработки информации является ее преобразование по каким-либо правилам или законам.

Оценивая информацию о состоянии окружающей среды мы выбираем наиболее целесообразное поведение. Процесс преобразования исходной информации в информацию, отражающую результат решения какой-либо задачи – это и есть решение задачи, поставленной перед человеком в любом виде его деятельности.

1.6.Информационные основы процессов управления.

Чтобы говорить об процессах управления необходимо понять, что из себя представляет система управления.

Определение. Система – это упорядоченная совокупность разнородных элементов или частей, взаимодействующих между собой и с внешней средой, объединенных в единое целое и функционирующих в интересах достижения единых целей.

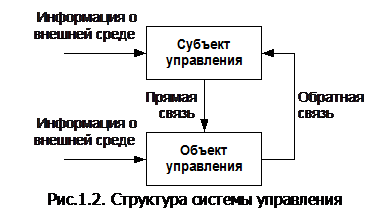

Система управления характеризуется наличием двух компонентов (рис.1.2):

Система управления характеризуется наличием двух компонентов (рис.1.2):

§ Субъекта управле-ния, реализующего формирование целей, принятие решений и обеспечивающего контроль за их выполнением;

§ Объекта управле-ния, выполняющего поставленные задачи.

Пример: промышленное предприятие: здесь субъект управления — это администрация, а объект управления — производственный коллектив, выполняющий работу и располагающий для этого необходимыми ресурсами.

Управление базируется на информации. В процессе управления возникают информационные потоки между объектом и субъектом управления, а также между ними и внешней средой. Направленность внутренних информационных потоков характеризует прямую и обратную связь в системе управления.

Система управления (субъект управления) на основе информации о состоянии объекта и информации, поступающей из внешней среды, определяет цели для объекта и воздействует на объект (прямая связь).

Обратная связь представляет собой движущийся в обратном направлении информационный поток, формируемый объектом управления.

В процессе функционирования происходят изменения в объекте управления. Субъект управления воспринимает информацию от объекта управления и новую информацию об внешней среде, обрабатывает ее, принимает новое решение и вырабатывает новое управляющее воздействие. И так далее. В процессе управления необходимая информация регистрируется, передается, хранится, накапливается и обрабатывается. Комплекс этих процедур составляет информационный процесс управления. Информация в этом процессе рассматривается и как предмет (исходная информация), и как продукт труда (результатная информация) системы управления. Исходная, первичная информация преобразуется в результатную, пригодную для формирования управленческих решений. По этим причинам информационный процесс является частью управленческой деятельности.

Для организации и реализации информационного процесса необходимы соответствующие средства и методы обработки информации, а также персонал, способный выполнять процедуры информационного процесса.

1.7.Информационная деятельность человека. Основные характерные черты информационного общества.

Развитие науки, образования обусловило быстрый рост объема информации, знаний человека. Если в начале прошлого века общая сумма человеческих знаний удваивалась приблизительно каждые пятьдесят лет, то в последующие годы — каждые пять лет. Информатика и компьютеры уже проникли практически во все сферы деятельности человека. Появилась необходимость в формировании новой, информационной технологии, деятельности человека.

Вот как ЮНЕСКО характеризует понятие «Информационная технология»:

Определение. Информационная технология — это комплекс взаимосвязанных, научных, технологических и инженерных дисциплин, изучающих методы эффективной организации труда людей, занятых обработкой и хранением информации; изучающих вычислительную технику и методы организации и взаимодействия ее с людьми и производственным оборудованием, их практические приложения, а также связанные со всем этим социальные, экономические и культурные проблемы.

Сами информационные технологии требуют сложной подготовки, больших первоначальных затрат и наукоемкой техники.

В настоящее время человечество завершает переход к информационному обществу, в котором можно эффективно и оптимально строить любую деятельность на основе овладения информацией о самых различных процессах и явлениях. В информационном обществе повышается качество не только потребления, но и производства, труд человека становится творческим и интеллектуальным, если он использует новые информационные технологии, значительно улучшаются условия труда.

Определение. «Информационная культура» — это совокупность способностей, знаний, умений и навыков, связанных с пониманием закономерностей информационных процессов в природе, обществе и технике, современными информационными и коммуникационными технологиями, со способностью и умением использовать средства информационных коммуникационных технологий при решении задач в своей практической деятельности.

1.8.Тренировочные тестовые задания по разделу 1.

(правильные ответы см. в конце пособия).

I. Информация, которая отражает истинное положение дел, называется:

1. Понятной

2. Достоверной

3. Объективной

4. Полной

5. Актуальной

II. Информация, которая важна в настоящий момент, называется:

1. Понятной

2. Достоверной

3. Объективной

4. Полной

5. Актуальной

III. Информация, объем которой достаточен для решения поставленной задачи, называется:

1. Понятной

2. Достоверной

3. Объективной

4. Полной

5. Актуальной

IV. По способу восприятия человеком различают следующие виды информации:

1. Текстовую, числовую, графическую, табличную

2. Научную, социальную, политическую

3. Обыденную, производственную, техническую

4. Визуальную, звуковую, тактильную

5. Математическую, биологическую, медицинскую

V. Какую информацию можно отнести к визуальной:

1. Запах цветов

2. Фотографии

3. Музыка

4. Вкус напитка

5. Ощущения холода

VI. Хранить аудиоинформацию можно, используя:

1. Учебник

2. Световую рекламу

3. Книгу

4. Магнитофонную кассету

5. Партитуру музыкального произведения

VII. Записную книжку используют с целью:

1. Передачи информации

2. Обработки информации

3. Хранения информации

4. Защиты информации

5. Транспортировки информации

VIII. Термин «информатизация общества» обозначает:

1. Увеличение количества избыточной информации

2. Увеличение роли средств массовой информации

3. Целенаправленное и эффективное использование информации во всех областях человеческой деятельности, достигаемое за счет массового применения информационных технологий

4. Массовое использование компьютеров

5. Введение изучения информатики в учебные заведения страны

§ Данные имеют табличную структуру:

§ Список продуктов, которые надо купить

§ Классный журнал со списком класса и оценками

§ Перечень Ваших друзей

§ Список музыкальных альбомов

§ Перечень предметов, которые Вы проходили в 9 классе

§ В процессе управления результатная информация используется для:

§ Отчета работы

§ Хранения в базе данных

§ Вычислений

§ Формирования управленческих решений

§ Воздействия на субъект управления

§ Представление информации

7. Язык как способ представления информации.

8. Количество информации.

9. Вероятностный подход к определению количества информации.

10.Понятие энтропии.

11.Формы представления информации.

12.Кодирование информации.

13.Единицы измерения количества информации.

2.1.Язык как способ представления информации. Количество информации.

Напомним одно из определений понятия «Информация».

Определение. Информация — это содержание сообщения, сигнала, памяти и т.д.

Примечание.

Очень важным при этом является способ представления той или иной информации. Только представив информацию в каком-либо виде, ее можно передавать. Чтобы понять содержание информации, надо знать правила (соглашения), по которым представление переводится в содержание, смысл.

Пример: Перед посадкой самолета в Лондоне стюардесса делает объявление: “Сейчас в городе идет дождь, температура воздуха – два градуса выше нуля”. Эту информацию она получила от бортинженера. Для передачи полученной информации она воспользовалась английским языком. В самолете есть люди, которые не понимают английский язык. Тогда информацию о погоде, переданную стюардессой на английском языке, они воспримут как некий “шум”, а не как совет приготовить зонтик.

Этот пример показывает, что при неизвестной форме представления информации, ее содержание не будет воспринято принимающей стороной.

Можно выделить, по крайней мере, четыре различных подхода к определению способа представления информации.

В быту слово "информация" часто применяется как синоним слов "сведения", "сообщение", "осведомление о положении дел". Очевидно, что количественно измерить такую информацию невозможно, в лучшем случае можно говорить о ее достоверности или недостоверности.

В кибернетике понятие "информация" используется для характеристики управляющих сигналов, которые обеспечивают устойчивое функционирование сложных систем. В этом случае следует говорить о конкретном представлении управляющих сигналов в виде конкретных технических характеристик этих сигналов, их единиц измерения, других свойств и параметров, дающих достаточно полное описание изучаемых сигналов.

В философии понятие "информация" тесно связано с такими понятиями как взаимодействие и познание. В процессе взаимодействия двух объектов происходят их изменения, можно сказать, что на них отпечатывается информация о взаимодействии. Человек познает окружающий мир, в его сознании накапливаются Знания, т.е. информация. Количественную оценку информации в этом случае произвести затруднительно, т.к. подобные знания зачастую носят смысловой, содержательно-описательный характер, который трудно поддается измерению.

В информатике понятие "информация" вводится как мера уменьшения неопределенности. В этом случае под информацией понимается изменение некоторой количественной величины, характеризующей состояние исследуемого объекта (системы, процесса, явления), определенной до и после опыта, проведенного над этим объектом.

Во всех отмеченных подходах к представлению информации важным является способ измерения количества информации. Существует несколько подходов к измерению количества информации Статистический, Семантический, Прагматический:

§ Статистический подход — оценивается количество информации в передаваемых сообщениях о состояниях некоторой системы, которая может иметь определённое количество дискретных состояний. Если до получения информации было известно сколько таких состояний может получать система и после получения стало известно в каком состоянии она оказалась, то можно получить количество принятой информации как меру снятия неопределённости о состоянии системы. Если считать, что все N состояний системы равновероятны, количество информации можно определить, используя формулу английского инженера Р.Хартли i = log2 N , причем N = 2 I

Пример: "Бросание монеты": перед броском существует неопределенность, как упадет монета предсказать невозможно. После броска реализуется полная определенность (например "орел"). Аналогично, при бросании четырехгранной пирамиды существуют 4 возможных исхода, а при бросании игрального кубика — 6 возможных исходов.

Вывод : чем больше возможных событий, тем больше начальная неопределенность результата и, главное, тем больше количество информации будет получено после проведения опыта .

§ Семантический подход — количество полученной информации измеряется с учётом её смысла для получателя. Оценивается количество смысла полученной информации, с помощью сравнения объёмов тезаурусов до и после получения информации, т.е. оно равно разности тезауруса Sп до получения информации Sп.0 и после получения информации Sп.1, т.е. I = Sп.1 – Sп.0 .

Определение. Тезаурус — свод слов, устойчивых словосочетаний, описывающих предметную область, сгруппированных и упорядоченных по некоторым правилам (например, в порядке убывания алфавита).

§ Прагматический подход — количество информации в данном случае оценивается как полезность сообщения. Для этого используется следующее соотношение I = log2 (P1/P0) , где P — вероятность решения задачи: P0 до получения сообщения и P1 после получения сообщения.

Определение. Вероятность — величина, которая может принимать значения в диапазоне от 0 до 1. Она может рассматриваться как мера возможности наступления какого-либо события, которое может иметь место в одних случаях и не иметь места в других.

Получение информации — это, в конечном счете, получение фактов, сведений и данных о свойствах, структуре или взаимодействии объектов и явлений окружающего нас мира с использованием некоторой абстрактной системы символов (жестов, знаков, рисунков и прочее) для представления содержательной информации.

В процессе развития человеческого общества люди выработали большое число подобных систем — языков. Среди них — язык жестов и мимики, язык рисунков и чертежей, язык музыки, разговорные языки и т.д.

Пример: Язык жестов — морской флажковый семафор. Язык музыки — ноты. Языки программирования — Visual Basic, Pascal, Perl, C.

Основой большинства языков является алфавит. Алфавит — это набор символов, из которых можно составить слова и фразы данного языка.

Пример:

§ Латинский алфавит (прописные буквы): A, B, C, D, E, F, G, H, I, J, K, L, M, N, O, P, Q, R, S, T, U, V, W, X, Y, Z.

§ Русский алфавит (прописные буквы): А, Б, В, Г, Д, Е, Ё, Ж, З, И, Й, К, Л, М, Н, О, П, Р, С, Т, У, Ф, Х, Ц, Ч, Ш, Щ, Ъ, Ы, Ь, Э, Ю, Я.

§ Алфавит десятичных цифр: 0, 1, 2, 3, 4, 5, 6, 7, 8, 9.

§ Алфавит двоичных цифр: 0, 1.

Примечание.

Простота двоичного алфавита обеспечила его широкое применение в вычислительной технике. Значения 0 и 1 в компьютерах представляются физическими состояниями “намагничено — не намагничено”, “есть напряжение — нет напряжения”.

Одним из самых распространенных способов представления информации является естественный (разговорный или письменный) язык. Люди обмениваются устными сообщениями, записками, посланиями. Они передают друг другу просьбы, приказы, отчеты о проделанной работе, описи имущества; публикуют рекламные объявления и научные статьи, хранят старые письма и документы. Одним из самых простых способов получения интересующей нас информации у собеседника состоит в задании ему вопросов, которые предполагают ответ, имеющий только два значения — “Да” или “Нет”.

Пример: Задаем человеку такой вопрос: «Вы сегодня обедали?». С одинаковой вероятностью следует ожидать ответ «Да» или «Нет».

Примечание.

Обозначить ответы «Да» и «Нет» можно не только словами, но и любым другим образом. Можно было бы взять буквы А и Е, либо цифры 3 и 7. Однако, для простоты записи обычно применяются символы двоичного алфавита 1 и 0.

Определение. Количество информации, которое можно получить при ответе типа «да-нет» на какой-либо вопрос, называется битом (bit — аббревиатура от binary digit — двоичная единица), причем бит — минимальная единица количества информации, ибо получить информацию, меньшую, чем 1 бит, невозможно.

Примечание.

Одно из главных понятий XX века — бит впервые было введено американским ученым-статистиком Джоном Тьюки в 1946 году.

2.2.Вероятностный подход к определению количества информации. Понятие энтропии.

Если обратить внимание на разговорные языки, например русский, то можно сделать интересные выводы. Для упрощения теоретических исследований в информатике принято считать, что русский алфавит состоит из 32 символов (е и ё, а также ь и ъ между собой не различаются, но добавляется знак пробела между словами). Если считать, что каждая буква русского языка в сообщении появляется одинаково часто (т.е. равновероятно) и после каждой буквы может стоять любой другой символ, то, используя двоичную логарифмическую меру измерения информации Хартли, можно определить количество информации в каждом символе русского языка как:

I = log2 32 = 5.

Однако, фактически все бывает не так. Во всех разговорных языках одни буквы встречаются чаще, другие — гораздо реже. Исследования говорят, что на 1000 букв приходится следующее число повторений:

| В русском языке: | В английском языке: |

| О 110, Е 87, А 75, И 75, Т 65... | Е 131, Т 105, А 86, О 80, N 71, R 68… |

Кроме того, вероятность появления отдельных букв зависит от того, какие буквы им предшествуют. Так, в русском языке после гласной не может следовать мягкий знак, не могут стоять четыре гласные подряд и так далее. Любой разговорный язык имеет свои особенности и закономерности. По этим причинам количество информации в сообщениях, построенных из символов любого разговорного языка, нельзя оценивать двоичной логарифмической мерой Хартли.

Какое количество информации тогда содержится, к примеру, в тексте романа "Война и мир", во фресках Рафаэля или в генетическом коде человека? Ответа на эти вопросы наука не даёт и, по всей вероятности, даст не скоро. А возможно ли объективно измерить количество информации? К задачам подобного рода относятся также следующая:

Пример: Являются ли равновероятными сообщения "первой выйдет из дверей здания женщина" и "первым выйдет из дверей здания мужчина". Однозначно ответить на этот вопрос нельзя. Все зависит от того, о каком именно помещении идет речь. Если это, например, вестибюль станции метро, то вероятность выйти из дверей первым одинакова для мужчины и женщины, а если это военная казарма, то для мужчины эта вероятность значительно выше, чем для женщины.

Для задач такого рода используется общая оценка количества информации Шеннона. Американский учёный Клод Шеннон в 1948 г. предложил формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе. Он использовал применяемую в математике и гидродинамике вероятностную меру неопределенности (энтропию) для того, чтобы в полной мере оценить состояние изучаемой системы и получить максимально возможную информацию о протекающих в этой системе процессах. Эта оценка количества информации, по-существу, является вероятностной мерой, и, как оценка неопределенности, она

Вывод : отражает способность какого-либо ис-точника проявлять все новые и новые состояния и таким образом отдавать информацию.

Шеннон энтропию определил как среднюю логарифмическую функцию множества вероятностей возможных состояний системы (возможных исходов опыта) [5] ) . Для расчета энтропии H Шеннон предложил следующее уравнение:

H = – ( p1log2 p1 + p2 log2 p2 + . . . + pN log2 pN),

где p i — вероятность появления i-е события в наборе из N событий.

Тогда количество информации, полученное исследователем после опыта будет не что иное, как разность между энтропией системы до H0 и после H1 опыта, или

I = H0 – H1,

причем если неопределенность в результате опыта снимается полностью имеем:

I = – H1 или I = Σ (p i log2 p i), i = 1,…,N .

Если события равновероятны, то количество информации определяется по формуле Хартли:

i = log2 N .

Пример: После экзамена по информатике, который сдавали студенты, объявляются оценки («2», «3», «4» или «5»). Какое количество информации будет нести сообщение об оценке учащегося A, который выучил лишь половину билетов, и сообщение об оценке учащегося B, который выучил все билеты..

Опыт показывает, что для учащегося A все четыре оценки (события) равновероятны, а для для учащегося B наиболее вероятной оценкой является «5» (p1 = 1/2), вероятность оценки «4» в два раза меньше (p2 = 1/4), а вероятности оценок «2» и «3» еще в два раза меньше (p3 = p4 = 1/8).

Тогда, количество информации, которое несет сообщение об оценке учащегося А, равно (на основании формулы Хартли)

i = log2 4 = 2,

а количество информации, содержащее в сообщении об оценке ученика В, есть

I = – (1/2 log21/2 + 1/4 log21/4 + 1/8 log21/8 + 1/8 log21/8) = 1,75.

Вычисления показали, что при равновероятных событиях мы получаем большее количество информации, чем при неравновероятных событиях.

2.3.Формы представления информации.

Дата: 2018-12-28, просмотров: 628.